नई दिल्ली, 9 जून - इंग्लैंड के टेस्ट कप्तान बेन स्टोक्स नाइटक्लब में हुई एक घटना.....

भारत निर्वाचन आयोग कल कांग्रेस प्रतिनिधिमंडल से करेगा मुलाकात

-

ट्रंप ने माना ईरान ने मार गिराया अमेरिका का गश्ती अपाचे हेलिकॉप्टर, बोले- सेना देगी जवाब

ट्रंप ने माना ईरान ने मार गिराया अमेरिका का गश्ती अपाचे हेलिकॉप्टर, बोले- सेना देगी जवाब

-

पंजाब में कल सरकारी बसों का होगा चक्का जाम

-

मुरादाबाद स्थित एक फैक्ट्री में आग लगी

मुरादाबाद स्थित एक फैक्ट्री में आग लगी

-

राजधानी के कई हिस्सों में बारिश

राजधानी के कई हिस्सों में बारिश

-

कांग्रेस प्रत्याशी मीनाक्षी नटराजन का नामांकन रद्द, किस बात पर BJP ने जताई थी आपत्ति

कांग्रेस प्रत्याशी मीनाक्षी नटराजन का नामांकन रद्द, किस बात पर BJP ने जताई थी आपत्ति

-

कुरुक्षेत्र की अंतर्राष्ट्रीय जाट धर्मशाला में लगेगा तीन दिवसीय उत्तर भारत सर्वखाप महापंचायत एवं चिंतन शिविर

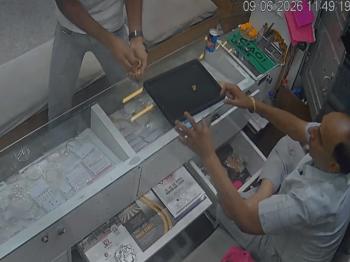

लुधियाना, 9 जून (प्रदीप भंडारी) - लुधियाना के सर्राफा बाजार में स्थित आतम ज्वेलर्स...

जीरकपुर, 9 जून (मनिंदर सिंह) – दशमेश कुश्ती अखाड़ा दयालपुरा के पहलवान राजवीर सिंह...

-

रामानुजन मैथमेटिक्स अवॉर्ड एग्जाम ऑर्गनाइजिंग कमेटी ने सरकारी स्कूलों के होनहार स्टूडेंट्स को सम्मानित किया

रामानुजन मैथमेटिक्स अवॉर्ड एग्जाम ऑर्गनाइजिंग कमेटी ने सरकारी स्कूलों के होनहार स्टूडेंट्स को सम्मानित किया

-

पंजाब सरकार भगवान वाल्मीकि तीर्थ स्थल के पवित्र तालाब की सफाई करेगी

पंजाब सरकार भगवान वाल्मीकि तीर्थ स्थल के पवित्र तालाब की सफाई करेगी

-

ऑफिस में लड़की की बेरहमी से हत्या करने वाला आरोपी गिरफ्तार

ऑफिस में लड़की की बेरहमी से हत्या करने वाला आरोपी गिरफ्तार

-

कल मुख्यमंत्री भगवंत मान के घर पर होगी कैबिनेट की मीटिंग

कल मुख्यमंत्री भगवंत मान के घर पर होगी कैबिनेट की मीटिंग

-

CID की टीम ममता बनर्जी के आवास पर पहुंची

CID की टीम ममता बनर्जी के आवास पर पहुंची

-

जबलपुर के कई हिस्सों में बारिश

जबलपुर के कई हिस्सों में बारिश

नई दिल्ली, 9 जून - पाकिस्तान के कब्जे वाले जम्मू-कश्मीर के मुजफ्फराबाद....

मोहाली 9 जून - अलटकलों और सियासी चर्चाओं के बीच मोहाली ..

-

जीरकपुर पुलिस ने CIA स्टाफ बनकर ज्वेलर से लूटपाट करने वाले 3 आरोपियों को गिरफ्तार किया

-

बगावत की आहट के बीच ममता के गुट का दावा, जानें कल्याण बनर्जी क्या बोले

बगावत की आहट के बीच ममता के गुट का दावा, जानें कल्याण बनर्जी क्या बोले

-

पटाखा फैक्ट्री में आग लगने से चार लोगों की मौत

पटाखा फैक्ट्री में आग लगने से चार लोगों की मौत

-

अप्रेंटिसशिप यूनियन के कर्मचारी बिजली के टावर पर चढ़े

अप्रेंटिसशिप यूनियन के कर्मचारी बिजली के टावर पर चढ़े

-

ढकौली के एक प्राइवेट अस्पताल में आंखों की सर्जरी ठीक से न करने का आरोप

ढकौली के एक प्राइवेट अस्पताल में आंखों की सर्जरी ठीक से न करने का आरोप

-

सीआईए अधिकारी बन ज्वेलर को किडनैप कर 10 लाख रुपये की फिरौती मांगी, 3 आरोपी गिरफ्तार

सीआईए अधिकारी बन ज्वेलर को किडनैप कर 10 लाख रुपये की फिरौती मांगी, 3 आरोपी गिरफ्तार

लुधियाना, 9 जून (रूपेश कुमार)- सेंट्रल इन्वेस्टिगेशन एजेंसी ED ने लुधियाना ..

नई दिल्ली, 9 जून - आम आदमी पार्टी के संयोजक अरविंद केजरीवाल ने ट्वीट किया...

-

नेशनल जस्टिस फ्रंट ने लुधियाना में लाडोवाल टोल प्लाजा को टोल फ्री किया

नेशनल जस्टिस फ्रंट ने लुधियाना में लाडोवाल टोल प्लाजा को टोल फ्री किया

-

मनप्रीत सिंह इयाली अकाली दल वारिस पंजाब में शामिल

-

भाजपा पंजाब अध्यक्ष केवल सिंह ढिल्लों का लुधियाना पहुंचने पर गर्मजोशी से किया स्वागत

भाजपा पंजाब अध्यक्ष केवल सिंह ढिल्लों का लुधियाना पहुंचने पर गर्मजोशी से किया स्वागत

-

ईडी के छापों ने व्यापारियों को बर्बाद कर दिया है - सिसोदिया

ईडी के छापों ने व्यापारियों को बर्बाद कर दिया है - सिसोदिया

-

हम अपने व्यापारियों के साथ खड़े हैं- मुख्यमंत्री मान

हम अपने व्यापारियों के साथ खड़े हैं- मुख्यमंत्री मान

-

गांव झोरड़ मलोट में 2 दलित युवकों के साथ हुई अमानवीय घटना की कड़ी निंदा - राजेश बाघा

गांव झोरड़ मलोट में 2 दलित युवकों के साथ हुई अमानवीय घटना की कड़ी निंदा - राजेश बाघा

वॉशिंगटन DC, 7 जून - द न्यूयॉर्क टाइम्स की एक रिपोर्ट के मुताबिक...

न्यूयॉर्क, 9 जून - US प्रेसिडेंट डोनाल्ड ट्रंप सोमवार रात NBA फ़ाइनल्स...

-

पटना डिस्ट्रिक्ट कोर्ट ने खान सर की गिरफ्तारी पर लगाई रोक

पटना डिस्ट्रिक्ट कोर्ट ने खान सर की गिरफ्तारी पर लगाई रोक

-

NIA द्वारा मानसा जिले के कुलाना गांव में छापेमारी

NIA द्वारा मानसा जिले के कुलाना गांव में छापेमारी

-

ED ने लुधियाना, बरेली और दिल्ली-नोएडा इलाके में 6 जगहों पर की छापेमारी

ED ने लुधियाना, बरेली और दिल्ली-नोएडा इलाके में 6 जगहों पर की छापेमारी

-

ई.डी. द्वारा जालंधर में छापेमारी

ई.डी. द्वारा जालंधर में छापेमारी

-

पंजाब के आठ जिलों में आज से हीटवेव की चेतावनी जारी

पंजाब के आठ जिलों में आज से हीटवेव की चेतावनी जारी

-

माता-पिता से नाराज़ होकर एक साथ गायब हुए 5 बच्चे

चंडीगढ़, 9 जून- मुख्यमंत्री भगवंत मान आज श्री फतेहगढ़ साहिब...

चीमा मंडी (संगरूर), 9 जून (गुरजीत सिंह चहल, जगराज मान) - संगरूर जिले के चीमा...

-

माणिक मोती

माणिक मोती

-

पश्चिम बंगाल के नेता सुवेंदु अधिकारी दिल्ली एयरपोर्ट पहुंचे

पश्चिम बंगाल के नेता सुवेंदु अधिकारी दिल्ली एयरपोर्ट पहुंचे

-

दुबई में भीषण सड़क हादसा, कई भारतीय श्रमिकों की दर्दनाक मौत

दुबई में भीषण सड़क हादसा, कई भारतीय श्रमिकों की दर्दनाक मौत

-

राज्यपाल हरि बाबू कंभमपति ने पवित्र स्नान और महायज्ञ में लिया भाग

राज्यपाल हरि बाबू कंभमपति ने पवित्र स्नान और महायज्ञ में लिया भाग

-

अमित शाह ने यमुना के कायाकल्प को लेकर एक समीक्षा बैठक की अध्यक्षता की

अमित शाह ने यमुना के कायाकल्प को लेकर एक समीक्षा बैठक की अध्यक्षता की

-

PM मोदी ने विशाखापत्तनम स्टील प्लांट में हुए हादसे पर जताया दुख

PM मोदी ने विशाखापत्तनम स्टील प्लांट में हुए हादसे पर जताया दुख

कोलकाता, 8 जून - तृणमूल कांग्रेस के करीब 20 सांसदों के समर्थन के दावे के साथ....

विशाखापत्तनम, 8 जून - आंध्र प्रदेश के विशाखापत्तनम स्टील प्लांट में हुए एक बड़े......

-

फाजिल्का पुलिस की बड़ी कार्रवाई, कापा गैंग के दो गिरफ्तार

-

कैबिनेट मंत्री हरदीप सिंह मुंडियां ने 33 और पटवारियों को नियुक्ति पत्र सौंपे

कैबिनेट मंत्री हरदीप सिंह मुंडियां ने 33 और पटवारियों को नियुक्ति पत्र सौंपे

-

सुखबीर सिंह बादल ने की ट्रेडर्स सेक्शन के 67 चुनाव क्षेत्रों के अध्यक्षों की नियुक्ति

सुखबीर सिंह बादल ने की ट्रेडर्स सेक्शन के 67 चुनाव क्षेत्रों के अध्यक्षों की नियुक्ति

-

श्री गुरु अर्जन देव जी का शहीदी दिवस मनाने के लिए 750 श्रद्धालुओं को मिला पाकिस्तान का वीज़ा

श्री गुरु अर्जन देव जी का शहीदी दिवस मनाने के लिए 750 श्रद्धालुओं को मिला पाकिस्तान का वीज़ा

-

बिजली कर्मचारियों ने बेरोजगार ITI पास युवाओं पर लाठीचार्ज के खिलाफ विरोध रैली निकाली

बिजली कर्मचारियों ने बेरोजगार ITI पास युवाओं पर लाठीचार्ज के खिलाफ विरोध रैली निकाली

-

जिला परिषद ऊना के 17 नवनिर्वाचित सदस्यों ने ली पद की शपथ

तेहरान, 8 जून - इस्राइल द्वारा ईरान पर किए गए हमलों के बाद एक बार फिर से.....

लखनऊ, 8 जून - पाकिस्तानी गैंगस्टर शाहजाद भट्टी और आईएसआई से जुड़े.....

-

इंडिया ब्लॉक की बैठक के बाद बोले खड़गे, धर्मेंद्र प्रधान के इस्तीफे की भी मांग की

इंडिया ब्लॉक की बैठक के बाद बोले खड़गे, धर्मेंद्र प्रधान के इस्तीफे की भी मांग की

-

भारत के बाद अब चीन जाएंगे नेपाली विदेश मंत्री: द्विपक्षीय संबंधों पर होगी चर्चा, क्या है यात्रा के मायने?

भारत के बाद अब चीन जाएंगे नेपाली विदेश मंत्री: द्विपक्षीय संबंधों पर होगी चर्चा, क्या है यात्रा के मायने?

-

निजी स्टाफ के तौर पर रिश्तेदार की नियुक्ति पर घिरे मंत्री जोसेफ, विवाद के बाद बहनोई ने दिया इस्तीफा

निजी स्टाफ के तौर पर रिश्तेदार की नियुक्ति पर घिरे मंत्री जोसेफ, विवाद के बाद बहनोई ने दिया इस्तीफा

-

केंद्रीय मंत्री के संपर्क में तृणमूल के बागी सांसद! ममता बनर्जी से अलग हुई बैठक के बाद हलचल

केंद्रीय मंत्री के संपर्क में तृणमूल के बागी सांसद! ममता बनर्जी से अलग हुई बैठक के बाद हलचल

-

ईरान में युद्ध के बीच भारतीयों के लिए अलर्ट: भारतीय दूतावास ने जारी की नई एडवाइजरी

-

मुख्यमंत्री विजय से मुलाकात के दौरान आर प्रज्ञानंद ने खेला शतरंज

मुख्यमंत्री विजय से मुलाकात के दौरान आर प्रज्ञानंद ने खेला शतरंज

IND vs AFG Highlights: भारत ने अफगानिस्तान को पारी और 300 रन से हराया, डेब्यू टेस्ट में चमके सुथार

भारत ने अफगानिस्तान को एकमात्र टेस्ट मैच में पारी और 300 रनों से ..

-

टीम इंडिया का स्टार बना मानव सुथार 6/33 भारत को मजबूत स्थिति में पहुंचाया

टीम इंडिया का स्टार बना मानव सुथार 6/33 भारत को मजबूत स्थिति में पहुंचाया

-

फिलीपींस में आए भूकंप में कम से कम 15 लोगों की मौत, 129 घायल

फिलीपींस में आए भूकंप में कम से कम 15 लोगों की मौत, 129 घायल

-

श्री मुक्तसर साहिब में युवकों को रस्सी से बांधकर घसीटने वाले 11 लोगों पर केस दर्ज

श्री मुक्तसर साहिब में युवकों को रस्सी से बांधकर घसीटने वाले 11 लोगों पर केस दर्ज

-

आम आदमी पार्टी ने की पंजाब महिला विंग के अलग-अलग पदाधिकारियों की नियुक्ति की घोषणा

आम आदमी पार्टी ने की पंजाब महिला विंग के अलग-अलग पदाधिकारियों की नियुक्ति की घोषणा

-

ताजा बर्फबारी से Bhalesa की वादियां हुईं और खूबसूरत

ताजा बर्फबारी से Bhalesa की वादियां हुईं और खूबसूरत

-

जालंधर में ट्रक और एक्टिवा की टक्कर, महिला की मौत

जालंधर में ट्रक और एक्टिवा की टक्कर, महिला की मौत

चंडीगढ़, 8 जून (प्रो. अवतार सिंह) - लुधियाना के दाखा से MLA मनप्रीत अयाली शिरोमणि...

चंडीगढ़, 8 जून (प्रो. अवतार सिंह) - लुधियाना के दाखा से MLA मनप्रीत अयाली शिरोमणि...

-

राजस्थान: जयपुर में अतिक्रमण हटाने से पहले प्रशासन अलर्ट, कई जगहों पर इंटरनेट बंद

राजस्थान: जयपुर में अतिक्रमण हटाने से पहले प्रशासन अलर्ट, कई जगहों पर इंटरनेट बंद

-

अमन अरोड़ा ने मुबारिकपुर फोकल पॉइंट पर 66 KV सब-स्टेशन का उद्घाटन किया

अमन अरोड़ा ने मुबारिकपुर फोकल पॉइंट पर 66 KV सब-स्टेशन का उद्घाटन किया

-

25 से 30 जून के बीच दिल्ली पहुंच सकता है मॉनसून

25 से 30 जून के बीच दिल्ली पहुंच सकता है मॉनसून

-

लाइनमैनों पर हुए लाठीचार्ज के विरोध में बिजली कर्मचारियों ने किया प्रदर्शन

लाइनमैनों पर हुए लाठीचार्ज के विरोध में बिजली कर्मचारियों ने किया प्रदर्शन

-

विदेश जाने के सपने ने रचा ठगी का जाल, 2 साल बाद मिला न्याय का रास्ता

विदेश जाने के सपने ने रचा ठगी का जाल, 2 साल बाद मिला न्याय का रास्ता

-

TMC नेता जहांगीर खान नेपाल बॉर्डर से गिरफ्तार

चंडीगढ़, 7 जून - चंडीगढ़ में मुख्यमंत्री भगवंत मान ने नए नियुक्त...

नई दिल्ली 8 जून -देश में बदलते राजनीतिक हालात पर

-

मिशन क्लीन पंजाब: डेराबस्सी बस स्टैंड पर सफाई अभियान शुरू

मिशन क्लीन पंजाब: डेराबस्सी बस स्टैंड पर सफाई अभियान शुरू

-

मुख्यमंत्री भगवंत मान आज करेंगे रोपड़ का दौरा

मुख्यमंत्री भगवंत मान आज करेंगे रोपड़ का दौरा

-

मान सरकार ने की मिशन क्लीन पंजाब की शुरूआत

मान सरकार ने की मिशन क्लीन पंजाब की शुरूआत

-

गुरु हरगोबिंद साहिब जी की गुरुगद्दी की सालगिरह, गुरुद्वारों में की गई खूबसूरत सजावट

गुरु हरगोबिंद साहिब जी की गुरुगद्दी की सालगिरह, गुरुद्वारों में की गई खूबसूरत सजावट

-

राजौरी: 'ऑपरेशन शेरावली' के तहत डोरिमल वन क्षेत्र में सुरक्षा बलों का सर्च ऑपरेशन जारी

राजौरी: 'ऑपरेशन शेरावली' के तहत डोरिमल वन क्षेत्र में सुरक्षा बलों का सर्च ऑपरेशन जारी

-

20 लाख रुपये की रिश्वत का मामला: ओ.पी. राणा की आज होगी पेशी

20 लाख रुपये की रिश्वत का मामला: ओ.पी. राणा की आज होगी पेशी

मनीला, 8 जून - आज सुबह फिलीपींस में 7.8 तीव्रता का भूकंप...